Thông tin liên hệ

- 036.686.3943

- admin@nguoicodonvn2008.info

Hãy hiểu kiến trúc Voice AI 3 thành phần - Chuyển đổi giọng nói thành văn bản (Speech-to-Text), LLM và Chuyển đổi văn bản thành giọng nói (Text-to-Speech) - và cách độ trễ ảnh hưởng đến trải nghiệm người gọi.

Hãy nghĩ về cuộc trò chuyện điện thoại tốt đẹp gần đây nhất của bạn. Người kia đã lắng nghe, hiểu ý bạn và phản hồi một cách tự nhiên. Không có những khoảng lặng khó hiểu. Không có câu "xin lỗi, bạn có thể nhắc lại được không?" sau mỗi câu.

Đó là những gì một Voice AI agent cần làm - trong vòng chưa đầy một giây. Và nó thực hiện điều đó bằng cách sử dụng ba thành phần hoạt động cùng nhau trong một quy trình. Hiểu được quy trình này là chìa khóa để xây dựng các agent có cảm giác tự nhiên thay vì robot.

Mọi Voice AI agent - cho dù được xây dựng trên Vapi, Retell, Bland hay code tùy chỉnh - đều hoạt động trên cùng một kiến trúc cơ bản:

Người gọi nói → [STT] → [LLM] → [TTS] → Người gọi nghe phản hồi

Hãy cùng phân tích từng thành phần.

STT lắng nghe âm thanh của người gọi và chuyển đổi nó thành văn bản. Chỉ vậy thôi. Nhưng làm tốt việc này lại khó hơn bạn tưởng.

Công cụ STT cần xử lý:

Giọng điệu và phương ngữ. Người gọi từ Texas nghe khác với người gọi từ Boston.

Tiếng ồn xung quanh. Xe cộ, quán cà phê, gió, tiếng người khác nói chuyện.

Thuật ngữ chuyên ngành. Thuật ngữ y tế, ngôn ngữ pháp lý, tên sản phẩm do công ty bạn đặt ra.

Sự gián đoạn. Mọi người không chờ AI nói xong trước khi chen vào.

Các nhà cung cấp STT phổ biến: Deepgram (nhanh, độ chính xác tốt), Google Cloud Speech, Whisper (mô hình của OpenAI, cũng chạy cục bộ) và AssemblyAI.

Thời gian trễ: 100-500ms. Deepgram và Google thường nhanh hơn. Whisper chính xác nhưng chậm hơn trừ khi bạn chạy nó trên phần cứng mạnh.

✅ Kiểm tra nhanh: Công cụ STT cần xử lý những gì ngoài nhận dạng giọng nói cơ bản?

Đáp án: Giọng điệu, tiếng ồn nền, thuật ngữ chuyên ngành và sự gián đoạn.

Sau khi lời nói của người gọi được chuyển đổi thành văn bản, LLM sẽ tìm ra ý nghĩa của chúng và tạo ra phản hồi. Đây là nơi "trí thông minh" tồn tại.

LLM xử lý:

Hiểu ý định. "Tôi cần lên lịch lại" có nghĩa là người gọi đã có một cuộc hẹn và muốn thay đổi nó.

Duy trì ngữ cảnh. Ghi nhớ rằng người gọi đã nói tên của họ là Sarah và cuộc hẹn của họ là vào thứ Năm.

Đưa ra quyết định. Nhân viên nên đặt lịch hẹn, chuyển tiếp cho người thật hay hỏi thêm câu hỏi làm rõ?

Tạo ra ngôn ngữ tự nhiên. Tạo ra văn bản nghe giống như những gì một người thực sự sẽ nói ra.

Các nhà cung cấp LLM phổ biến cho giọng nói: GPT-4o và GPT-4o-mini (OpenAI), Claude (Anthropic), Gemini (Google). Đối với giọng nói nói riêng, các mô hình nhanh hơn như GPT-4o-mini thường được ưu tiên vì độ trễ quan trọng hơn trí thông minh tối đa.

Độ trễ: 200-2000ms. Đây thường là điểm nghẽn lớn nhất. Một phản hồi phức tạp từ một mô hình lớn có thể mất đến 2 giây. Một lời xác nhận đơn giản từ một mô hình nhanh có thể mất 200ms.

TTS lấy phản hồi văn bản của LLM và chuyển đổi nó thành âm thanh. TTS hiện đại không nghe giống như một robot đang đọc kịch bản - mà nghe giống như một người đang nói chuyện.

Công cụ TTS xử lý:

Ngữ điệu. Sự lên xuống của giọng nói. Câu hỏi nên nghe giống như câu hỏi.

Nhịp độ. Khoảng dừng tự nhiên giữa các cụm từ và câu.

Cảm xúc. Sự ấm áp cho lời chào, sự đồng cảm cho lời phàn nàn, sự nhiệt tình cho tin tốt.

Lựa chọn giọng nói. Nam, nữ, trẻ, già, trang trọng, thân mật - bạn có thể chọn.

Các nhà cung cấp TTS phổ biến: ElevenLabs (chất lượng tốt nhất, tự nhiên nhất), PlayHT, Cartesia (độ trễ cực thấp) và những nhà cung cấp dịch vụ đám mây (Google, Amazon Polly, Azure).

Thời gian trễ: 200-800ms. ElevenLabs cho âm thanh tuyệt vời nhưng lại làm tăng độ trễ. Cartesia nhanh hơn nhưng âm thanh đầu ra kém tự nhiên hơn một chút.

✅ Kiểm tra nhanh: Thành phần nào trong quy trình xử lý thường gây ra độ trễ nhiều nhất? Đáp án: LLM, ở mức 200-2000ms.

Đây là nơi mọi thứ kết hợp lại. Cộng độ trễ từ cả ba thành phần lại và bạn sẽ có tổng thời gian phản hồi:

| Thành phần | Nhanh | Điển hình | Chậm |

| STT | 100ms | 250ms | 500ms |

| LLM | 200ms | 500ms | 2000ms |

| TTS | 200ms | 400ms | 800ms |

Tổng | 500ms | 1150ms | 3300ms |

Người gọi sẽ cảm thấy thế nào?

Dưới 500ms: Cảm giác tức thì. Giống như đang nói chuyện với một người sắc sảo.

500-800ms: Tự nhiên. Hầu hết mọi người sẽ không nhận thấy sự khác biệt. Đây là mức lý tưởng.

800-1500ms: Chấp nhận được. Có một chút tạm dừng, nhưng vẫn tự nhiên như đang nói chuyện.

1500-2500ms: Khó xử. Người gọi bắt đầu tự hỏi liệu đường dây có bị ngắt không.

Trên 2500ms: Tệ. Mọi người cúp máy hoặc bắt đầu lặp lại lời nói của mình.

Retell, một trong những nền tảng hàng đầu, đạt được độ trễ khoảng 600ms từ đầu đến cuối. Đó là tiêu chuẩn cần hướng tới.

Tất cả những gì chúng ta đã thảo luận cho đến nay đều là kiến trúc xếp tầng - âm thanh trải qua ba bước riêng biệt theo trình tự. Nhưng có một cách tiếp cận mới hơn.

Âm thanh → STT → Văn bản → LLM → Văn bản → TTS → Âm thanh

Ưu điểm

Linh hoạt.

Có thể kết hợp nhiều nhà cung cấp khác nhau.

Thay Deepgram bằng Whisper, hoặc GPT-4o bằng Claude.

Mỗi thành phần đều độc lập.

Nhược điểm

Ba bước chuyển đổi đồng nghĩa với ba lần độ trễ. Và thông tin bị mất trong quá trình chuyển đổi - giọng điệu, sự nhấn mạnh, cảm xúc không được giữ nguyên sau khi chuyển đổi giọng nói thành văn bản.

Âm thanh → Mô hình S2S → Âm thanh

Các mô hình chuyển đổi giọng nói thành giọng nói xử lý âm thanh trực tiếp. Không có chuyển đổi văn bản nào ở giữa. API thời gian thực của OpenAI sử dụng phương pháp này.

Ưu điểm

Độ trễ thấp hơn (bỏ qua hai bước chuyển đổi).

Giữ được sắc thái giọng nói.

Có thể phát hiện cảm xúc trong giọng nói của người gọi.

Nhược điểm

Ít tùy chọn hơn - đây là công nghệ mới hơn.

Ít kiểm soát hơn đối với các thành phần riêng lẻ.

Khó gỡ lỗi hơn vì không có bản ghi văn bản ở giữa.

Bạn nên sử dụng cái nào? Đối với hầu hết các trường hợp sử dụng trong kinh doanh năm 2026, kiến trúc xếp tầng vẫn là lựa chọn thiết thực. Nhiều nền tảng hỗ trợ nó, dễ gỡ lỗi hơn và công cụ cũng hoàn thiện hơn. Nhưng hãy để mắt đến S2S - đó là xu hướng đang hướng tới.

✅ Kiểm tra nhanh: Sự đánh đổi chính giữa kiến trúc xếp tầng và S2S là gì?

Câu trả lời: Xếp tầng mang lại sự linh hoạt và dễ gỡ lỗi hơn nhưng độ trễ cao hơn. S2S mang lại độ trễ thấp hơn và xử lý âm thanh phong phú hơn nhưng ít tùy chọn hơn và khó gỡ lỗi hơn.

Đây là một thủ thuật giúp các voice agent hoạt động nhanh hơn đáng kể: Stream.

Nếu không có stream, quy trình sẽ chờ LLM tạo ra toàn bộ phản hồi trước khi TTS bắt đầu chuyển đổi nó thành âm thanh. Với stream, LLM gửi các đoạn văn bản khi chúng được tạo ra và TTS bắt đầu nói câu đầu tiên trong khi LLM vẫn đang viết câu thứ hai.

Không sử dụng stream:

LLM tạo ra phản hồi đầy đủ ————————→ TTS chuyển đổi toàn bộ văn bản → Âm thanh phát

Với stream:

LLM tạo ra đoạn 1 → TTS đọc đoạn 1 → Người gọi nghe thấy

LLM tạo ra đoạn 2 → TTS đọc đoạn 2 → Người gọi nghe thấy

LLM tạo ra đoạn 3 → TTS đọc đoạn 3 → Người gọi nghe thấyĐiều này có thể giảm độ trễ cảm nhận được từ 500ms trở lên. Mọi nền tảng Voice AI lớn đều hỗ trợ stream và bạn nên luôn bật tính năng này.

Hãy theo dõi một cuộc trao đổi duy nhất qua toàn bộ quy trình:

Người gọi nói: "Chào, tôi muốn đặt lịch hẹn vào thứ Ba tuần tới."

STT (150ms): Chuyển đổi âm thanh thành văn bản: "Chào, tôi muốn đặt lịch hẹn vào thứ Ba tuần tới."

LLM (400ms): Hiểu ý định (yêu cầu đặt lịch), kiểm tra hệ thống để tìm các khung giờ trống, tạo ra câu trả lời: "Chắc chắn rồi! Tôi có giờ trống lúc 10 giờ sáng và 2 giờ chiều thứ Ba tuần tới. Giờ nào phù hợp với bạn hơn?"

TTS (300ms): Chuyển đổi câu trả lời thành âm thanh tự nhiên với ngữ điệu lên cao ở câu hỏi.

Tổng cộng: 850ms. Người gọi hầu như không nhận thấy sự tạm dừng.

Và với tính năng stream, người gọi nghe thấy "Chắc chắn rồi! Tôi có giờ trống lúc..." trong khi LLM vẫn đang hoàn thành câu. Độ trễ cảm nhận giảm xuống còn khoảng 500ms.

Đó là voice AI. Ba thành phần, một quy trình, dưới một giây.

Voice AI sử dụng quy trình ba giai đoạn: STT (tai) → LLM (não) → TTS (giọng nói)

Độ trễ tổng cộng là tổng của cả ba giai đoạn - hãy hướng đến mức dưới 800ms để có trải nghiệm tự nhiên

LLM là nút thắt cổ chai lớn nhất về độ trễ (200-2000ms), vì vậy các mô hình nhanh hơn rất quan trọng

Kiến trúc xếp tầng mang lại sự linh hoạt; S2S mang lại độ trễ thấp hơn nhưng ít tùy chọn hơn

Stream cho phép người gọi nghe phản hồi trước khi câu trả lời đầy đủ được tạo ra, giảm đáng kể thời gian chờ đợi cảm nhận

Nguồn tin: Quantrimang.com

Ý kiến bạn đọc

Những tin mới hơn

Những tin cũ hơn

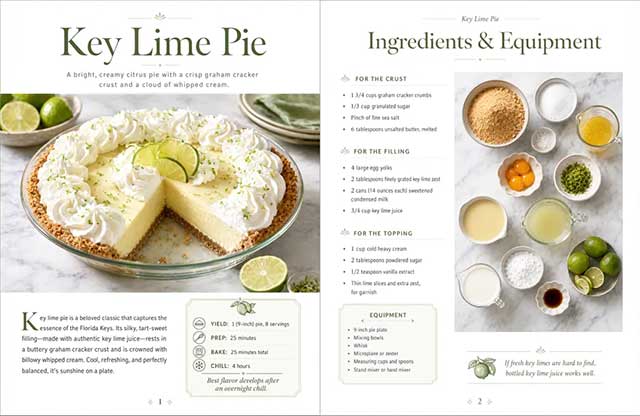

ChatGPT Images 2 là gì? Cách tạo infographic, tài liệu với ChatGPT Images 2

ChatGPT Images 2 là gì? Cách tạo infographic, tài liệu với ChatGPT Images 2

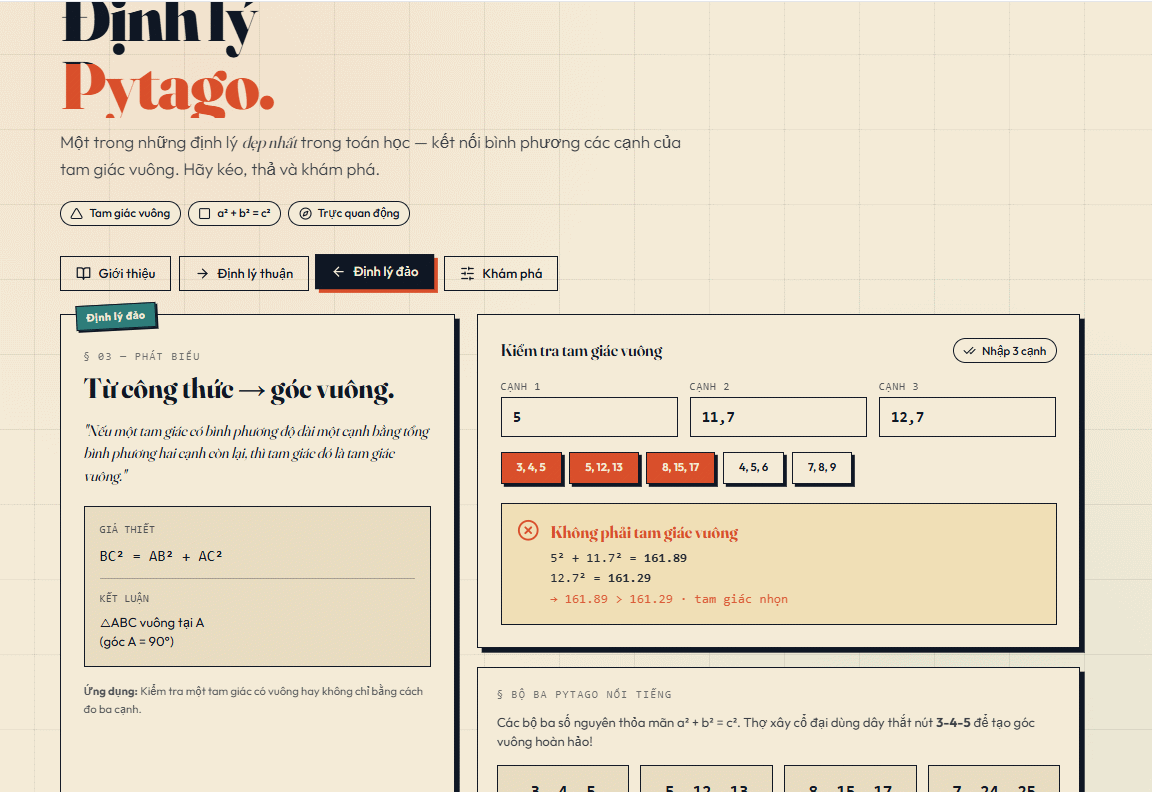

Cách tạo trang web mô tả kiến thức trực quan trên Canva AI

Cách tạo trang web mô tả kiến thức trực quan trên Canva AI

Cách thức hoạt động của Voice AI

Cách thức hoạt động của Voice AI

Thiết kế hội thoại cho AI Voice Agent

Thiết kế hội thoại cho AI Voice Agent

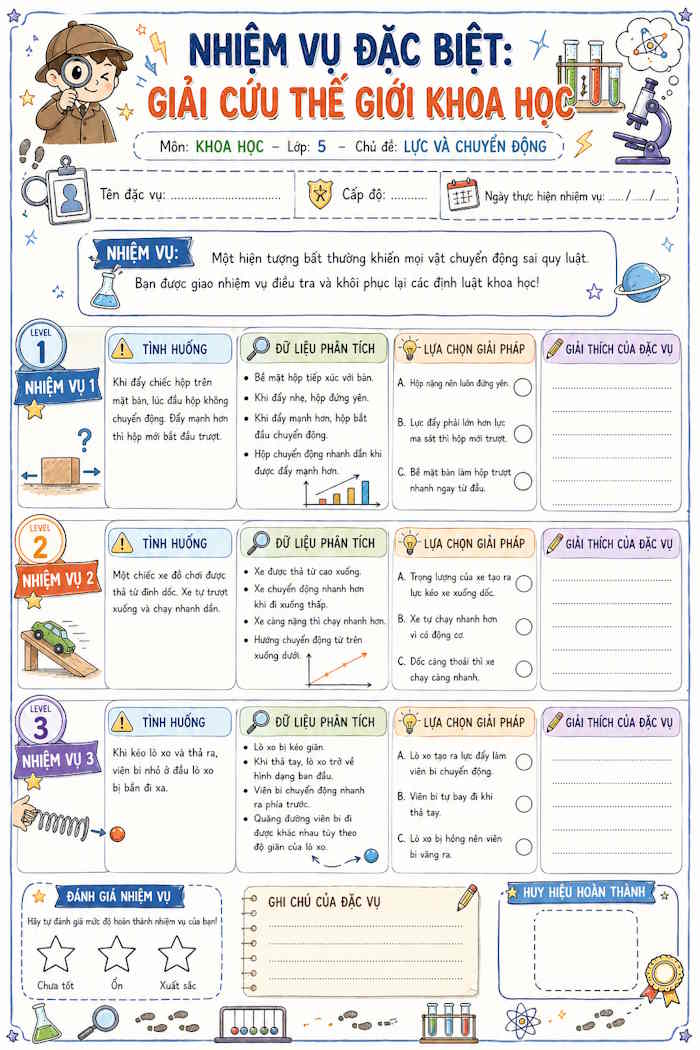

Prompt tạo phiếu học tập Thám tử khoa học trên ChatGPT

Prompt tạo phiếu học tập Thám tử khoa học trên ChatGPT

Mẹo thiết kế nội thất với ChatGPT Images 2.0 cực dễ

Mẹo thiết kế nội thất với ChatGPT Images 2.0 cực dễ

7 cách ứng dụng OpenClaw trong thực tế bạn nên biết: từ trading bot đến AI agent doanh nghiệp

7 cách ứng dụng OpenClaw trong thực tế bạn nên biết: từ trading bot đến AI agent doanh nghiệp

Kỹ thuật viết prompt cho AI Voice Agent

Kỹ thuật viết prompt cho AI Voice Agent

Hướng dẫn dịch slide thuyết trình trên Canva AI

Hướng dẫn dịch slide thuyết trình trên Canva AI

Prompt thiết kế nội thất với ChatGPT Images 2.0

Prompt thiết kế nội thất với ChatGPT Images 2.0

Hướng dẫn tạo đoạn hội thoại cho topic trên Twee

Hướng dẫn tạo đoạn hội thoại cho topic trên Twee

Workflow cho người dùng Claude Code thành thạo: Nhật ký, quy tắc CLAUDE.md và khả năng mở rộng

Workflow cho người dùng Claude Code thành thạo: Nhật ký, quy tắc CLAUDE.md và khả năng mở rộng

Quy trình làm việc nâng cao và các trường hợp ngoại lệ trong Copilot Cowork

Quy trình làm việc nâng cao và các trường hợp ngoại lệ trong Copilot Cowork

Hướng dẫn biến video thành bài giảng tương tác thú vị

Hướng dẫn biến video thành bài giảng tương tác thú vị

Làm chủ phiên Claude Code

Làm chủ phiên Claude Code

5 điều bạn cần biết trước khi sử dụng OpenClaw

5 điều bạn cần biết trước khi sử dụng OpenClaw

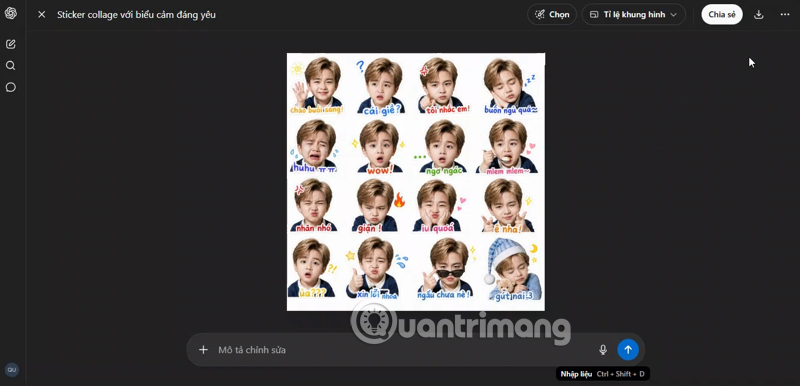

Cách tạo Sticker em bé bằng ChatGPT Images 2.0

Cách tạo Sticker em bé bằng ChatGPT Images 2.0

Prompt tạo ảnh thiết kế tóc theo khuôn mặt trên ChatGPT Images 2.0

Prompt tạo ảnh thiết kế tóc theo khuôn mặt trên ChatGPT Images 2.0

Khắc phục câu trả lời sai trong 10 giây trong phiên Claude Code

Khắc phục câu trả lời sai trong 10 giây trong phiên Claude Code

Framework quyết định 5 bước sau mỗi phiên Claude Code

Framework quyết định 5 bước sau mỗi phiên Claude Code